某バンドサークルのコンピアルバムVol5の解説とコメント(その8, 3&13曲目と反省)

シリーズ第8回目(最終回)は、アルバムの3、13曲目の解説と筆者の反省を書く。

#03. RAT

筆者は最初この曲を聴いてすごい曲が出てきたと思った。作曲のテクニックもさることながら、この複雑な世界観をジャズロック的なスタイルで表現するのに、このように実力のあるメンバーをよく揃えたなと思った。楽器の数が多いのにそれぞれが上手く出る所と控える所のメリハリがつけられている(普通は各楽器が出ずっぱりで混雑した感じになるという、俗に言う”引き算が出来てない”状態になる)。さらに音の選び方を良く分かっていて(ジャズの和音の作り方は音が変な風になるかどうかのギリギリの所を攻めていて、音の選び方を間違えると下手な感じになってしまう)、皆さん広いジャンルの音楽を経験してきたんだなと筆者は感心した。

なお、4月末に筆者がCDを最初に聴いた時はコード進行が全然分からなくて、今でも途中のラップ部分のコード進行の一部がわからない。そしてこの曲については筆者が採譜したコード進行にはあんまり自信がない。すまん。

今回の企画をふりかえる

非常に大変だった。当初は5月の連休中に完了すると思っていたコード解析が1ヶ月もかかってしもうた。

しかし筆者はこの解析をやってたいへん勉強になった。一つ一つの曲の一つ一つの音にこだわりがあり、そういう発見はこの解析を通してでなければ発見出来なかったであろう。

あと、筆者は5月中は音楽理論の教科書を読み直しまくって、さらに本屋で持ってない教科書を見つけては買い足すなどして音楽理論の研究をやりまくった。こうして筆者には先月の時点よりも格段に多くの知識と経験が蓄積したと思う。そして今、筆者の書いた最初の方の文章(さらにコンピアルバムVol2の文章)を見直してみるとその語彙力のなさに絶望する。このように筆者は自らの小ささにいつも絶望しているのだが、その反面、音楽の世界の広大さにはロマンを感じざるをえない。音楽は宇宙である。

音楽理論は作曲に必要か?

必ずしも必要ない。皆さんも何人かの作曲者に聞いてみると良いが、理論を知らなくても実際に曲は作れる。筆者は音楽というのは本来、自分の感覚で楽しいと思うものを作るのが一番よくて、「理論に従って作りました」というのは順番が逆と思う。

いっぽう、理論を知っていて得をすること(というか伸びるタイプの人)も居るだろう。それは、某バンドサークル界隈では理系大学生が多いということで、こうした理系的な性分の人はこの方法によって作曲力が向上するかもしれない。なお筆者は極端な例で、筆者はもはや完全に理系の思想(物事の美しさの背後には合理性があるという信仰、自らのセンスに自信がないのでその拠り所を完全に理論に求めるスタンス)に魂を売ってしまったので常時そうなっているのである。というか最早、筆者は原始の楽しい感じで音楽を考えることはできなくなってしまった。これは聖書に書かれているという原罪的なアレである。話が逸れたが、理論との接し方としては個々人にとって「自分の表現にとって有益かどうか」で判断してもらえれば良いと思う。

ところで、音楽理論を学ぶことのメリットというのは、その一つは音楽の表現に名前が付けられることにあると思う。こうして、「ここはツーファイブワンだね」とか「ここはパッシングディミニッシュだね」とか、先人たちの築いた理論体系に共通の言語でもってアクセスすることができる。自分の表現したい音があって、それを自分で苦労しながら見つけていくのは楽しいけれど、表現手法をカタログから選ぶように好きにできるとしたら、それは贅沢で良いことだろうと思う。

その反面、理論的な正確さのみにこだわりすぎて曲を作ることは良くない。例えば「ウルトラハッピーソング」のサビの場所、セカンダリドミナントでCメジャーが鳴る場所があるが、ここの主旋律の音がミのフラットなのでコードはCmだろうと思ってそう変えてみたら、なんだか全然面白くない風になってしまった。というわけで、理論からはみ出すこともまた表現の一つなのだと思う。

コード進行のセンスをつけるために

自分の好きな曲のコード進行を片っ端から解析することを勧める。バンドスコアを持っていればちゃんとコード進行が書いてあるし、今はネットで検索すればたいていの曲のはすぐ出てくる。で、これを暗記するくらいに弾きまくる。そうすると、コード名と音の感じが実感を伴って身につくとおもう。

そしてさらにステップアップするのに、こうした自主制作アルバムの曲は格好の題材だとおもう。ここで重要なのは、「答えがググっても出てこない」ということである。これを自力で本気で解析してみる。そしてできれば誰かと一緒にやって答え合わせをする。こうすることで曲の解釈の幅が広くなると思う。

今日の筆者は昨日の筆者にとってまるで別人みたいなのか?

筆者がこうして古巣のサークルの活動に関与するのは、やはり若手の成長を見たいがためでもある。大学生の頃というのは時間も若さもあり、毎日楽器の練習を好きでやっている若手はしばらく経った頃には見違えるほど上手くなっていることがある。そんな成長を見守るのがOBとしては楽しみなのである。

こうして若手が劇的に成長をするように、筆者自身もまた劇的に変化して行かねばと思う。一日一日を経ることにまるで別人になったかのように成長していく人間でありたい。

#13. ありのまま

来年

筆者の現在の職の任期は次の3月で切れてしまうので、来年の春に筆者が生きている保証はない。しかし、来年筆者が存命していて、かつテンションがあれば、また次のアルバムが出たら曲の音楽理論的な解説をやろうと思う。読者諸君の中で音楽理論の楽しさに目覚めた人がいたならば、またその時は筆者と一緒に研究をやってくれよな!

(おわり)

某バンドサークルのコンピアルバムVol5の解説とコメント(その7, 11-12曲目)

シリーズ第7回目は、アルバムの11-12曲目について解説していく。

#11. アイスマスター

この曲は色々とネタを詰め込めるだけ詰め込んでてんこ盛りなのだが、この曲(というかこのバンド)は、「全部好きだからどれか一つには選べない」という若者の欲求が昔からのテーマなのであってこれが良い。むしろこのスタイルが必然なのである。

筆者はこの曲は、平成時代のアイコンを詰め込めるだけ詰め込んだ(平成を代表するゲームであるポケモン、Negiccoのようなアイドル、オタ芸、バブル期のディスコなど)作品だと解釈しており、まさしく平成から令和への転換を象徴する作品だと思う。

さて、平成の時代には日本(や世界)の音楽シーンも社会も劇的に変わったが、趣味が多様化・細分化し、SNSが瞬時にトレンドを拡散する現代、そしてその先にある、人工知能が無尽蔵に音楽を生成し、VRとネットワークによってリアルタイムで感覚が共有できる未来、そんな新時代令和にはどんな音楽シーンが広がっていくのであろうか。映像、感覚、ストーリー、体験と結びついた、今までみたことの無いような総合的なエンターテインメントが生まれるのか、それとも、焼畑農業の成れの果てのような不毛な世界が待っているのだろうか。

#12. 終わりの

筆者はこの曲を聞いて凄い若手が出てきたなと思った(注:筆者はノゾム君は知ってる)。歌詞も曲も詩的で綺麗で、たった二人でもよくこの終末感が表現できているなと思う。ボーカルのダイナミックレンジ(声量や音域の幅)がすさまじく広い。また2人の呼吸もばっちりである。(実はこの曲は機械のクリックでテンポを調べてみると、BPM=82から86あたりの範囲でかなり変動している。しかし、2人がシンクロしているので、曲を聞いていてもまったくそのような違和感はなく、むしろテンポの絶対値のゆらぎが心地よさにさえなっていると思う。)

(つづく)

某バンドサークルのコンピアルバムVol5の解説とコメント(その6, 8-10曲目)

シリーズ第6回目は、アルバムの8-10曲目について解説していく。

#08. また明日

#09. 荒波

この曲は荒波というタイトルだが、その名の通り波の情景がわかる気がする。(曲の雰囲気でその人の記憶や脳内のイメージが想起されるというのはよく考えてみると凄いことである。)筆者はこの理由について、以下のように解釈している。

・コード進行はたぶん Bmaj7 → C# → E#m。一曲を通してこのシンプルなコード進行が続き、淡々と寄せては返す波を想起させる。

・細かく動くギターのアルペジオによって波が混ざり合った細かい泡の動きのようなものが思い浮かぶ。

・クリーンで幻想的な音作りとは裏腹に、歌詞が鬱積したような複雑な心境を醸しており、「混ざり合って」という単語のイメージもあり、割と灰色の彩度の低い光景が思い浮かぶ。

・「広告塔」や「足音」という単語が出てくるので、もしや荒波というのは街の雑踏とか人混みの比喩?

なお、間奏のところのハイハットオープン・クローズを演奏するの所のテンポに気をつけよう。

#10. 寒中水泳

この曲はアルバム中で音楽理論面でも演奏面でも最高難易度の曲である。

筆者は色々試行錯誤をして以下のようにコードを解釈した。原曲と比べてやたらとつるんとなってしまったが、がんばって作ったので是非聴いていただきたい。

この曲はテンションノートを多用しており、いくつかの楽器で音を鳴らすと倍音が干渉して音が濁る恐れがあった。特にAメロはルートの音に対していつも増4度の音が含まれる(ファとシ、ドとファ#)という緊張した和音構成なので、ピアノの高い方の音域を使って、できるだけ音が濁らないようにした。

サビの直前のコード進行は、「陽を落としてしまった」の「た」の音はC#だと解釈して、クラシック風にC#dimを使うことを考えてこのようにコード進行を設計した。

(つづく)

某バンドサークルのコンピアルバムVol5の解説とコメント(その5, 5-7曲目)

シリーズ第5回目は、アルバムの5-7曲目について解説していく。曲名は略称で表記しているが、これは曲をググったときにこのページが最初に出てくるとアレなのでそうした配慮によるものである。

#05. ニューバランス少女

この曲は敢えてF#mのコードのみを使った、いわば単色の、墨一色で書かれた書画のような骨太の作品だと思う。このようにコードを1つしか使わないという高難易度の曲であるが、曲が変化しながら展開していくようによく工夫がされていると思う。

いっぽうこの曲では音作りがちょっと惜しい。以下、ミキシングについてそれぞれのパートをどうすると良いかという筆者の意見を述べる。

クラッシュシンバル: もうちょっと派手に

ハイハット: OK

ボーカル: 音量上げて高音の抜けを良くすべし(コンプレッサ使っても良い)。

ギター: ボーカルとかぶる音域削る。もう少し高音を上げても良い。

スネア: 高音の抜けを良くする

ベース: OK

キック: OK

サビ前の「エフシャープマイナーセブン」のところのバランスはOK。あとAメロで若干ボーカルのテンポが速い気がするので、楽器隊と合わせると良いと思う。

#06. 証

この曲はダイアトニックコードではないコードが多用されており、それがセンスの良い斬新な感じを出している。例えば0:44に登場するII#のコードや、その前後に登場するVmとかIVmといった(通常はメジャーで使われる)コード、あと2:15に登場するVIである。

と、このように、筆者は音を拾って何のコードが鳴っているかという採譜はできたものの、これがどういう仕組になっているのかを正確に説明することができない。すまん。

・0:44に登場するII#のコードは、ハ短調(=変ホ長調)からの借用和音かと思う

・VmとかIVmがマイナーになっているのは長調→短調への転調なんだと思う

・2:15に登場するVIは何の調に転調しているのかは分からん

あと、

・曲中に出てくるIのトニックは、何か音を足すなりしてそこまで安定しないふうにした方が良いのではないかと思う。

・例えば、前奏やサビの途中に出てくるIのトニックは、I7とするほうが筆者は良いのではないかとおもう(動画2:24からを参照)。

#07. Amazing

この曲は本人の曲紹介解説にもあるように、高級車に乗っているような感じがする。筆者はその理由について、以下のように解釈している。

・コード進行はゆったりしていて余裕がある。

・テンポが安定しているので高級車のような安心感がある。

・いっぽう、ドラムやベースは細かく動いており、音数は多く、それがスピード感を出している。

・楽器の種類が少ないながらも、音作りがしっかりしている。倍音が干渉することもなく、素の音がよく響いている。

・なお、この曲のコード進行はたぶん Gmaj7(9) → Dadd9onF# → E7(9) → D

(つづく)

某バンドサークルのコンピアルバムVol5の解説とコメント(その4, 4曲目)

シリーズ第4回目はアルバム4曲目の「レイトショー by 電波塔」を解説する。この曲も凄い曲で、曲紹介にもあるように、遊び心あふれる、しかも詩的で爽快な作品だと思う。

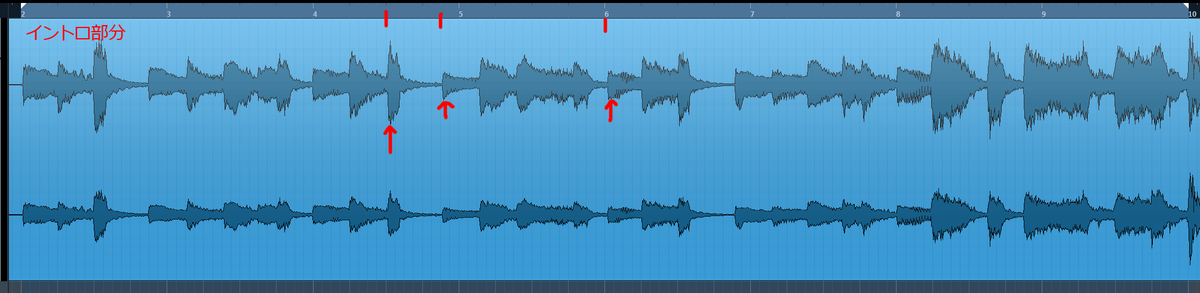

イントロ

Dbmaj7 . . . Dbm7(13) . . .

Cm7 . . . Bm7 . . .

Bbm7 . . . Eb7(9) . . .

Ab . . G Gb . Eb .

冒頭は(トニックではなく)サブドミナントから始まり、次いきなりマイナーコードになって、次からベースが順次下降する。この大局的な流れの上にメジャーセブンス、マイナーセブンス、9度、(のちに11度も出てくる)、13度のテンションノートが加わってきて、これはジャズのコード進行である。

このBbm7 → Eb7(9) → Abというのはツーファイブワンのコード進行であるが、トニックであるAbに着地してもこのコードでじっとしていなくて、すぐ半音下のGへと滑るようにコードが進行している。筆者はこの「トニックのAbに留まらない」というコード進行の特徴が、この曲の面白さ、地球が自転して時間の進んでいくさま、お祭りの賑やかさような感じを出しているとみている。

というわけで、以降皆さんがこの曲のコード進行を見る際には、「テンションノート」と「Abが全然出てこない、出たとしてもすぐ別のコードに行ってしまう」という点に改めて注意してほしい。

スピード感ある展開

またこの曲は展開が独特でいい意味で型破りだと思う。繰り返しの回数も型にはまっていなくていい。サビもスピード感をもって過ぎていく。「爽快だね」と言ってシャッフルになって途中から転調して半音上がる。この展開はとても爽快感ある。

というわけで動画で見ていただこう

こうすればもっと良くなるというコメント

イントロの部分のリズムをもっとタイトにしていくと良いと思う。

(つづく)

某バンドサークルのコンピアルバムVol5の解説とコメント(その3, 2曲目)

シリーズ第3回目はアルバム2曲目の「梅雨 by luxalapis」を解説する。筆者はこの曲もすばらしいと思う。

この曲の良い点

この曲は表現したいテーマがはっきりしているところが良い。季節は梅雨ということで、天候も自分の心も暗くなっているところ、でも自分を奮い立たせて前に動き出そうというポジティブな心情が歌われている。歌詞が詩的で良い。ぽつぽつと単語が歌われていくにつれて情景がリアルに想起されていく。韻を踏んでいる場所が多々あって言葉遊びとしても面白い。

コード進行を解析していくと相当高度なテクニックが使われていると感じた。しかもこれが曲の世界を表現するのに効果的に使われていると思う。

イントロ

Gmaj7 . . . . . . . Am6 . . . . . . .

Bm . . . . . . . C . . . . . . .

Gadd9 . . . . . . . DonA . . . . . . .

Bm . . . . . . . Cmaj7 . . . D . . .

見ていくと、長7度、マイナーコードに6度、add9などが登場する。これらの追加された音によって曲の面白みが断然増していて、どうしようもなく暗い鬱積したふうでもなく、能天気なふうでもない、この曲の独特の雰囲気を作っているのだとおもう。

AメロBメロ

GonB . . . . . . . GonC . . . . . . .

GonC# . . . . . . . GonD . . . . . . .

Gadd9onB . . . . . . . Gadd9onC . . . . . . .

Gadd9onC# . . . . . . . D . . . . . . .

Bm . . . C . . . Gadd9 . . . . . . .

Bm . . . Cmaj7 . . . D . Am7onD . D. D7

AメロではギターはずっとGを弾いていてベースだけが順次進行していく。筆者はベースの音を拾っていって初めて「こんな音の組み立て方だったのか」と驚いた。筆者はこれは、もやもやする心情の表現、そして、この先の展開をよりドラマチックに演出する為の意図があってのものだと解釈した。

その後Bメロからは場面が転換する。コードの複雑さが少し除かれ、しかもメロディーの起伏も大きくなり、音の高さも一段階上がって、しっかりとした変化がつけられている。

サビ

G... GonB... C... B... Em... D... A7onD#... D...

G... GonB... C... B... Em... D... Cadd9... D...

G.......

サビからはさらにコードがシンプルになって開放的な雰囲気になる。Cが鳴った後に(ト長調に無い音を入れた)III度メジャーのBが鳴り、VI度マイナーのEmに行く。この次、ドッペルドミナントのA7onD#が入る。この変化(と、さらに起伏を大きくしたメロディーと、3本目のギター)によって曲の一番の聞かせどころであるサビがダイナミックになっているのだと思う。

Cメロ

Am . . . D . . . G . . . . . . .

F#dim . . . B . . . Em . Ebm Dm7 . G .

Am . . . D . . . Gmaj7 . . . . . . .

Am . . . . . . . D#dim(onB) . . . B . . .

Cメロもコード進行レベルで他とは違う雰囲気になっている。diminishなどの不協和音系のコードの使いどころがうまい。

というわけで動画で見ていただこう

筆者の勝手なコメントとしては、2:54のところトニックのGを何か別のコードにするとギターソロの続いていく感が出て良くなるのではないかとおもうが、ここをどのコードに変えると良いのかは筆者もよくわからない。3:06のギターのGコードは、直前のGとちょっと違うGを弾くと良いとおもう。

(つづく)

某バンドサークルのコンピアルバムVol5の解説とコメント(その2, 14曲目)

はじめに

第2回目として、14曲目、ウルトラハッピーソング by テレフタリック を解説していきたい。筆者は当初、このシリーズ企画で曲の解説をやっていくのに、アルバムの頭から順番にやるべきだと思った。しかし、この曲が日常の筆者の脳内で常に鳴っているほど好きすぎて早速コード進行を解析したので、第二回目にこの曲を紹介することにした。

この曲の良い点

この曲の何が良いかと言うと、まず音が綺麗なこと。全部の楽器の音、特にボーカルがとてもクリアに録音できている。綺麗な音で聞こえるのは録音のテクニックもさることながら各メンバーの演奏が上手いからである。

またバンドの世界観がしっかりしていることが良い。音づくり、歌詞、曲の雰囲気などハッピーな感じがよく出ている。

そして音楽理論的な観点から言うと、ルート音の選び方、9度、7度の音の使い方など和音の作り方が良い。

いっぽう、だからこそ、コード進行について、コードの定義をはっきりさせたらもっと良いという点、別のコードを割り当ててもいけるだろうと思う点もいくつかある。そこで筆者は、(勝手に)先程言った音作りの良い部分のコード名と聞こえ方を対応させて説明するための動画を作った。そして動画の後半では、筆者なりのコード進行の代替案を(完全にお節介だが)言わせてもらうこととする。このように筆者が代替案を公開するのは、若い衆がコード進行の設計で迷った時にこうやってしっくり来るコードを探すんだと、コードの割り当ての候補は何通りかありえるんだと、さらにその際、音楽理論の知識を持っているとコード探しに役に立つんだという具体例として示したいがためである。

というわけで、この曲のコード進行を解析していく。この曲の調は、楽譜で書くとフラットが4つの変イ長調である。

イントロ

この曲はまずイントロが良い。そのコード進行はこうなっている。

Ab . Abadd9 . Fm . Fm(11) .

E . . . Eb . . .

コードに付いている数字は、「ルートの音に対して何度上のインターバルにある音を追加するのか」を指定する数字である。基本的なコードに数字は付いていなくて、こうした数字の付いたコードは原則的には不協和音になるのだが、ちょっと変わった響きを使うことで、普通と違う新鮮な感じを出したり、安定したコードが鳴った時の着地感を一層強くすることが出来る。

さて、イントロの前半では、ギターが ラb とシb の音を鳴らしている。このシb の音は、ルートがラbの時には9度の音となるし、ファならば11度の音になる。この響きが曲に清涼感を出している。そしてこの次に突然Eのコードが入って、(これは変イ長調の音には無い音を多分に含んでいるので異物のようなものであるが、)この一時の転調ののちに、半音下がってドミナントのEbになり、Aメロの頭でトニックのAbに綺麗に着地する。結果的にこの流れの起点となるEのコードが気持ちの良い気分の転換になっている。

Aメロ(二回目)

Aメロ(二回目)のコード進行を見てみる。

Ab . . . BbmonG . Cm? .

Fm . . . Ebm7 . GbonAb .

AbonDb . . . Cm7 . . .

Bbm . . . ファミファソ

2度の順次進行と5度のダイナミックな動きが多用されている。そして7度の音の使い方もうまい。特筆すべきは3行目の頭のAbonDbのコードで、トニックのAbの下にDbが配置されている。前後のベースの動きを見ると、Abから完全4度のDbになり、その後Db→C→Bbと順次下降する動きをしている。これが絶妙である。

サビ直前

もう一つ特筆したいのは、サビ直前のコードのEb +9。 この音はサビに着地する前の布石として不安定でトリッキーな響きを出しており、サビのトニックへの解決感を一層強く演出している。

というわけで動画で見ていただこう

…とここまでやったあとで、(筆者も知っている世代の後輩の)ぴーもえさんとりょうへい君がメンバーだったということが分かった。良い曲なので、是非歌い継がれていくことを願っている。

(つづく)